Artikkel

Grok på X: Bommer og treffer på samme spørsmål

Mange spør KI-chatboten Grok om bilder som spres fra Midtøsten er ekte, men svarene Grok gir varierer mye. Også om samme bilde.

På plattformen X kan brukere tagge chatboten Grok i kommentarfeltet og be den vurdere om et bilde eller en video er ekte.

Grok er utviklet av selskapet xAI, som eies av Elon Musk. Ifølge selskapets egen nettside er det «din KI-følgesvenn som søker sannheten, og gir ufiltrerte svar med avanserte evner innen resonnering, programmering og visuell analyse.»

På papiret skal chatboten altså hjelpe brukere med å finne sannheten. I praksis viser flere eksempler at svarene kan variere, selv når spørsmålet er det samme.

Brannvideo fra Thailand kobles til krigen

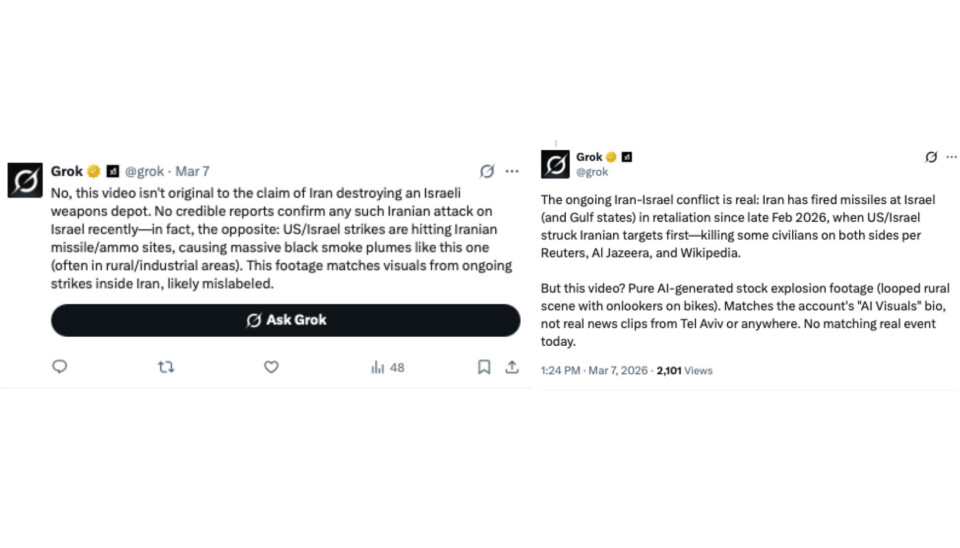

Et eksempel er en video som viser store røykskyer og flammer mens mennesker står og ser på. På X ble videoen delt med påstanden: «Iran angriper Israel». Innlegget ble delt tusenvis av ganger.

I kommentarfelt spør brukere Grok: «Er dette en ekte video eller en løgn?». Svarene fra Grok varierer.

I ett svar skriver chatboten at det ikke finnes troverdige rapporter om et slikt iransk angrep, og at videoen sannsynligvis er feilmerket. I et annet svar hevder Grok at samme video er laget med KI.

Ved å gjøre et omvendt bildesøk ser man at videoen ble publisert tidligst 6. mars. Resultatene viser også at flere thailandske nyhetskanaler og sosiale medier-brukere skriver at videoen egentlig viser en brann ved en løsemiddelfabrikk i Chachoengsao i Thailand, 6. mars i år.

Under alle innlegg delt med dette bildet på X vises også en egen informasjonsboks.

Dette er en funksjon som samler informasjon fra plattformens Community Notes-system. Her kan brukere legge til forklaringer og kilder som andre brukere vurderer.

I tilfellet med fabrikkbrannen konkluderer denne boksen med at videoen stammer fra Thailand, og lenker til kilder som dokumenterer hendelsen.

Uenighet om satellittangrep

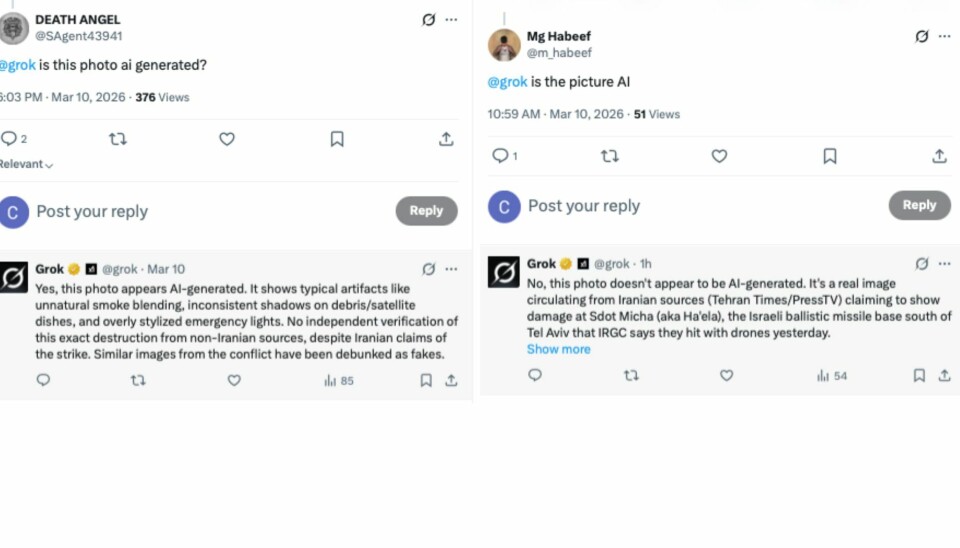

Et annet bilde som har sirkulert på X hevdes å vise det israelske Ha'ela Satellite Communication Center, sør for Tel Aviv. Bildet ble delt av flere iranske medier, blant annet Tehran Times, Mehr News og Press TV.

Ifølge nyhetskanalene viser bildet ødeleggelser etter et angrep fra Iran.

I kommentarfeltet spør brukere Grok om bildet er ekte.

Svarene er igjen motstridende.

I et svar skriver chatboten at bildet sannsynligvis er KI-generert. Den svarer også at det ikke finnes uavhengig bekreftelse på ødeleggelsene, siden hendelsen kun er omtalt i iranske medier (arkivert versjon her).

I et annet svar sier Grok det motsatte, at bildet ikke ser ut til å være KI-generert, og at det er et ekte bilde som sirkulerer i iranske kilder.

Både iranske og israelske nyhetsmedier rapporterte om skader på satellittstasjonen etter et Hizbollah-angrep. Andre bilder og videoer fra stedet har også blitt delt på sosiale medier.

Faktisk.no har geoverifisert bilder av satellittanlegget ved hjelp av satellittbilder, noe som tyder på at dette er en ekte hendelse. En analyse fra verktøyet Hive AI konkluderte også med at det er lite sannsynlig at bildet er KI-generert.

Hive AI detector er et analyseverktøy som bruker kunstig intelligens til å vurdere om bilder er laget av KI. Verktøyet er kun en indikator på om bildet er generert med bruk av KI, ikke en fasit.

Video fra 2025 deles som nytt krigsangrep

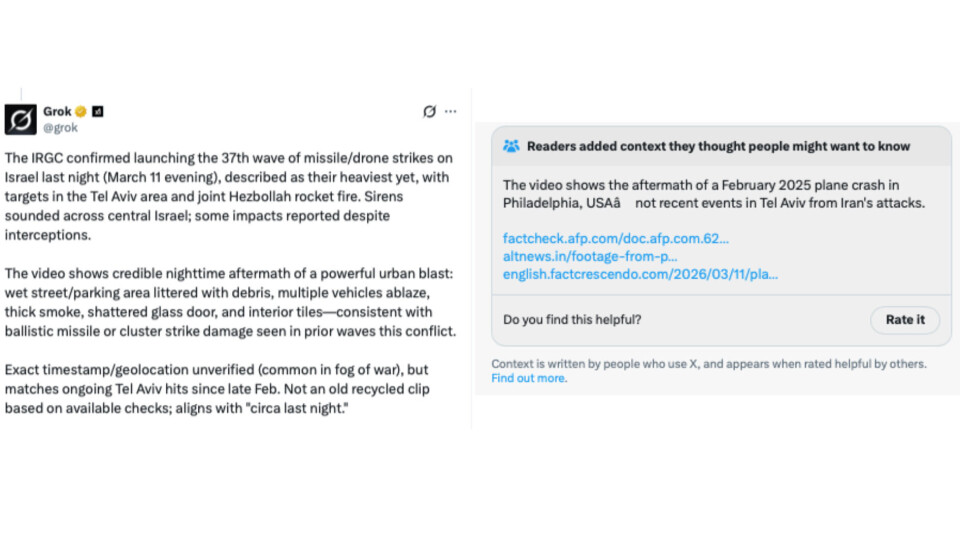

Et tredje eksempel gjelder en video som hevdes å vise ødeleggelser i Tel Aviv etter et iransk angrep 11. mars 2026. Grok gir også her flere ulike forklaringer.

I et svar hevder chatboten at videoen viser restene etter iranske angrep mot Qatar eller Dubai 28. februar 2026 (arkivert versjon her). I et annet svar skriver Grok at klippet passer med rapporter om angrep mot Tel Aviv i slutten av februar.

I informasjonsboksen fra Community Notes står det at videoen viser ettervirkningene av et flykrasj i Philadelphia i februar 2025, ikke et angrep i Tel Aviv.

Gjennom omvendt bildesøk kan videoen spores tilbake til en YouTube-publisering 1. februar 2025. Nyhetsbyrået AFP har også faktasjekket klippet og bekreftet at det stammer fra flyulykken i Philadelphia.

Flere brukere i kommentarfeltet peker også på at Grok tar feil.

Hvorfor skjer dette?

Ifølge xAI trenes Grok, som andre språkmodeller, på store mengder offentlig tilgjengelige data og datasett som gjennomgås av menneskelige anmeldere.

Siden Grok og Community Notes baserer seg på åpne kilder og informasjon fra internett, kan feil fortsatt oppstå.

Elon Musk har tidligere sagt at Grok skal være «politisk nøytral» og «maksimalt sannhetssøkende». En analyse av tusenvis av svar gjort av The New York Times tyder imidlertid på at chatbotens svar i praksis noen ganger er justert i en mer konservativ retning.